elasticsearch安装及使用可参考博文:Elasticsearch7.9.2+Kibana7.9.2安装使用

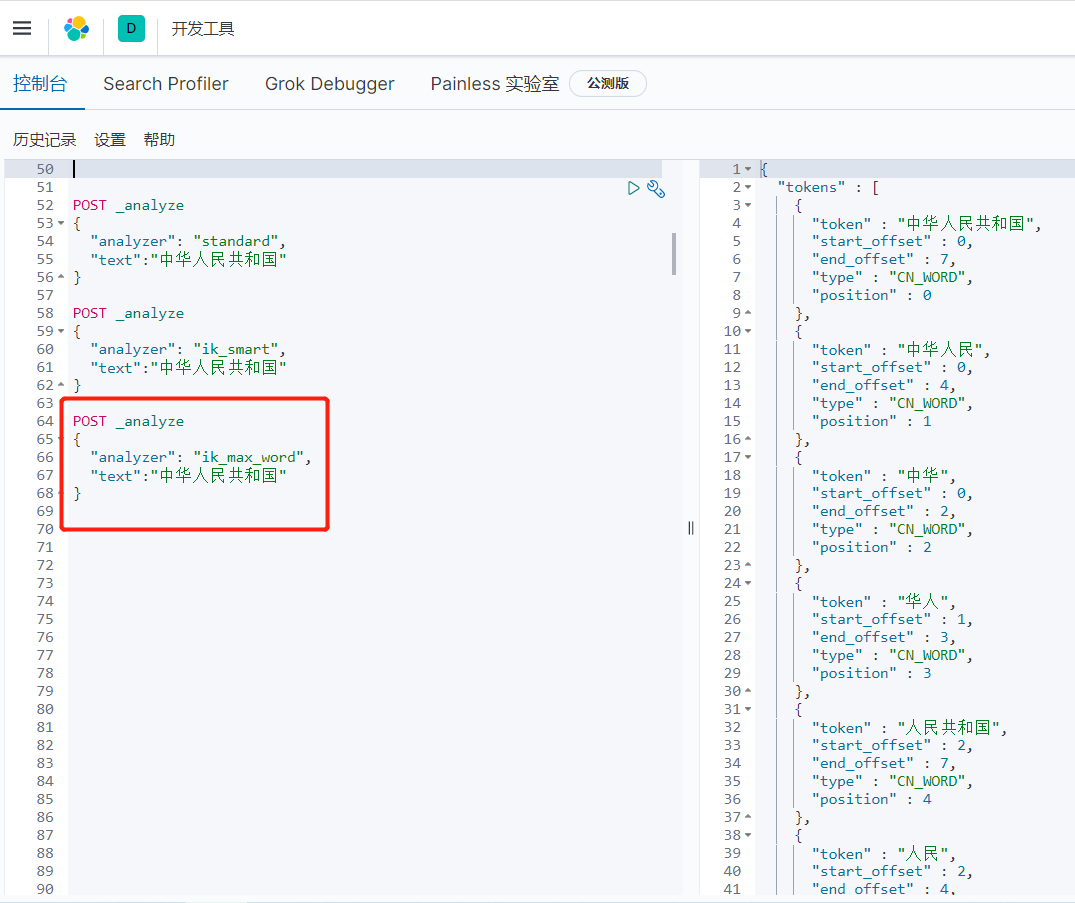

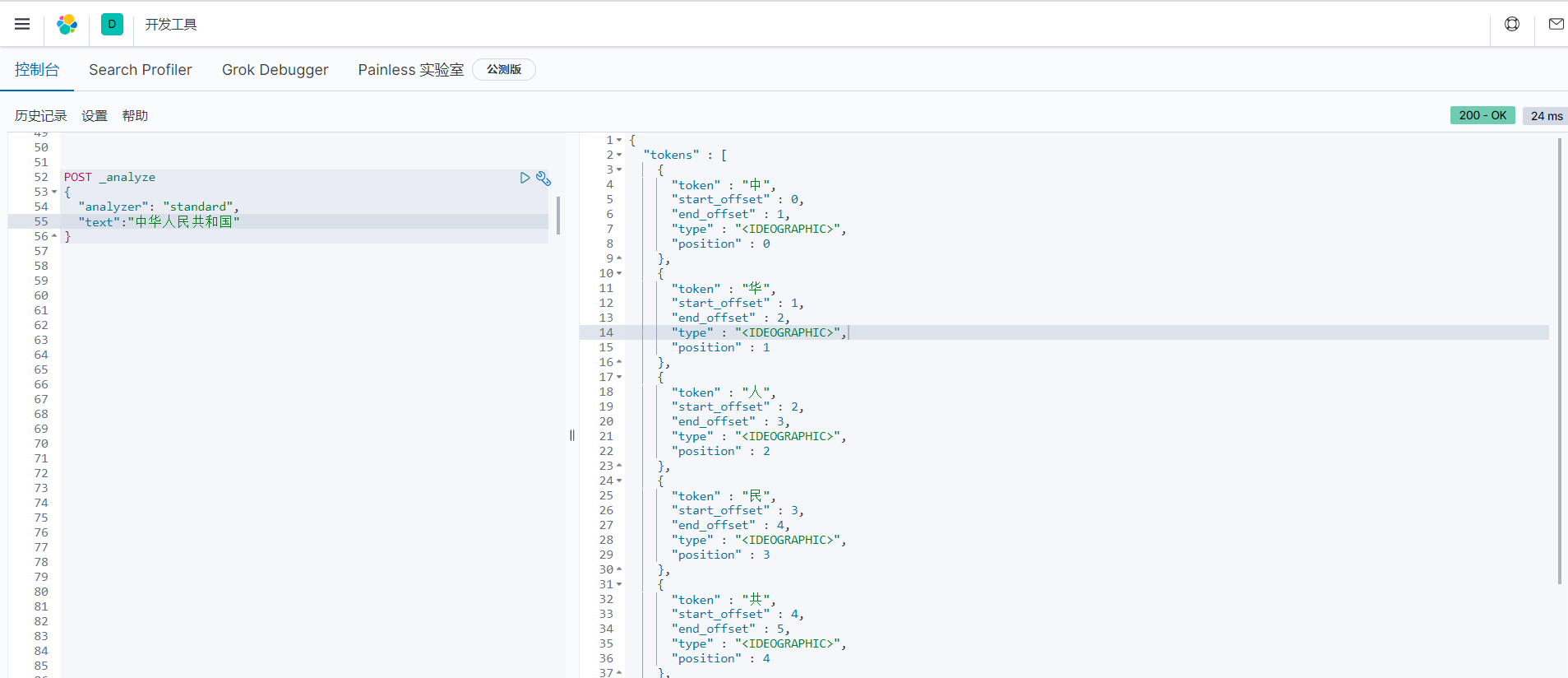

elasticsearch默认提供了standard分词器,但对中文的分词效果不尽人意:

可以看出,把词语分成了一个个的汉字,这并不是我们想要的,接下来介绍下中文分词器-IK分词器的安装及使用。

1、IK分词器下载及安装

github: https://github.com/medcl/elasticsearch-analysis-ik

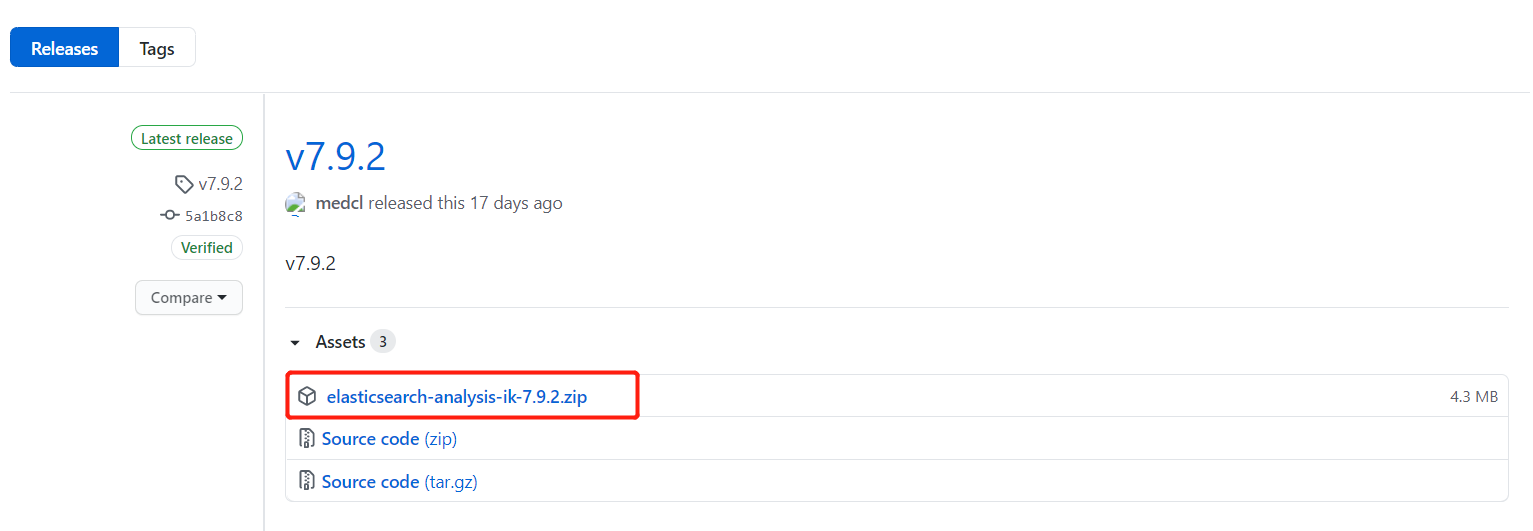

各版本分词器下载: https://github.com/medcl/elasticsearch-analysis-ik/releases

选择版本与elasticsearch一致的版本:7.9.2

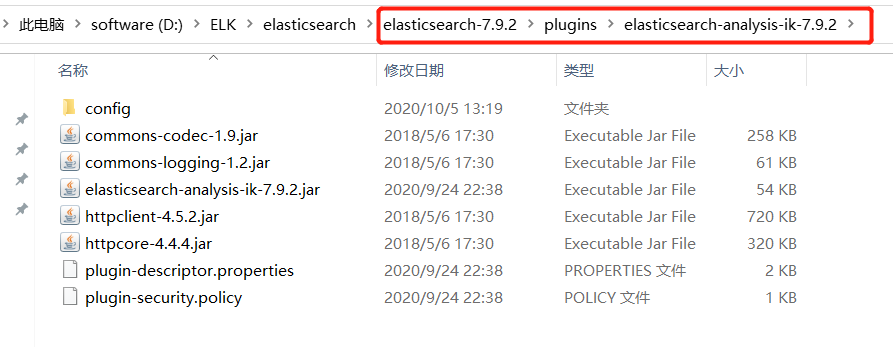

下载后解压,将解压后的文件夹elasticsearch-analysis-ik-7.9.2 拷贝至 elasticsearch的plugins文件下:

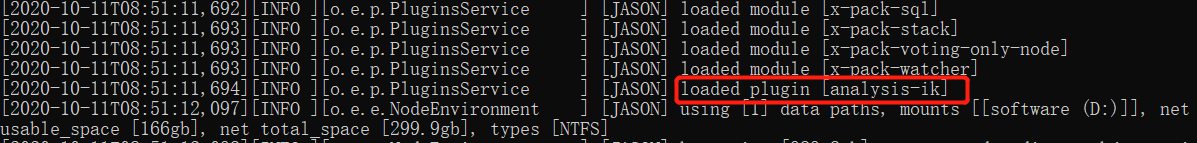

然后重启elasticsearch,控制台有如下输出:

2、使用IK分词器测试分词

IK分词器有两种分词模式:ik_smart 和 ik_max_word 模式。

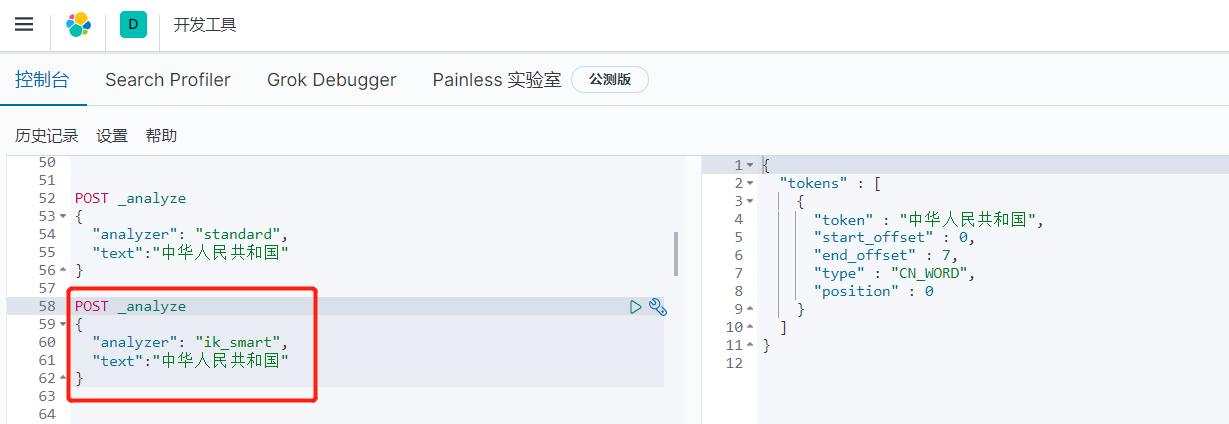

2.1、ik_smart

会做最粗粒度的拆分,比如会将“中华人民共和国”拆分为中华人民共和国。

使用Kibana开发工具,输入如下请求:

POST _analyze

{

"analyzer": "ik_smart",

"text":"中华人民共和国"

}

2.2、ik_max_word

会将文本做最细粒度的拆分,比如会将“中华人民共和国人民大会堂”拆分为“中华人民共和国、中华人民、中华、华人、人民共和国、人民、共和国等词语。

请求如下:

POST _analyze

{

"analyzer": "ik_max_word",

"text":"中华人民共和国"

}

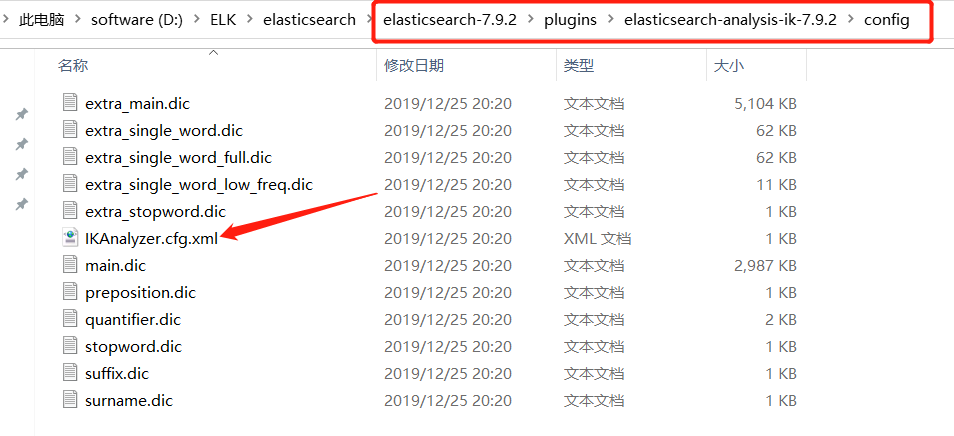

3、扩展词典

在 elasticsearch-analysis-ik-7.9.2 文件夹 conf 目录下,找到 IKAnalyzer.cfg.xml 配置文件,

文件内容如下:

<?xml version="1.0" encoding="UTF-8"?>

<!DOCTYPE properties SYSTEM "http://java.sun.com/dtd/properties.dtd">

<properties>

<comment>IK Analyzer 扩展配置</comment>

<!--用户可以在这里配置自己的扩展字典 -->

<entry key="ext_dict">custom.dic</entry>

<!--用户可以在这里配置自己的扩展停止词字典-->

<entry key="ext_stopwords"></entry>

<!--用户可以在这里配置远程扩展字典 -->

<!-- <entry key="remote_ext_dict">words_location</entry> -->

<!--用户可以在这里配置远程扩展停止词字典-->

<!-- <entry key="remote_ext_stopwords">words_location</entry> -->

</properties>

其中custom.dic为自定义的扩展字典,7.9.2版本的分词器插件中没有该文件,需要自己新建,

内容可以根据自己需要,自定义分词的文字。

保存后重启elasticsearch即可看到自己想要的分词效果。